😎 공부하는 징징알파카는 처음이지?

[논문리뷰] Temporal Fusion Transformersfor Interpretable Multi-horizon Time Series Forecasting 본문

[논문리뷰] Temporal Fusion Transformersfor Interpretable Multi-horizon Time Series Forecasting

징징알파카 2022. 9. 23. 14:18220923 작성

<본 블로그는 Bryan Lim, Sercan O. Arik, Nicolas Loeff, Tomas Pfister 님의 논문 참고해서 공부하며 작성하였습니다 :-) >

https://arxiv.org/abs/1912.09363

Temporal Fusion Transformers for Interpretable Multi-horizon Time Series Forecasting

Multi-horizon forecasting problems often contain a complex mix of inputs -- including static (i.e. time-invariant) covariates, known future inputs, and other exogenous time series that are only observed historically -- without any prior information on how

arxiv.org

🟣 Abstract

- Multi-horizon 예측에는 종종 정적 (즉, 정적)을 포함하는 입력의 복잡한 혼합이 포함

- 시간 불변) 공변량, 알려진 미래 입력 및 과거에만 관찰되는 다른 외생 시계열은 대상과 어떻게 상호 작용하는지에 대한 사전 정보가 없음

- 일반적으로 실제 시나리오에 있는 모든 범위의 입력을 사용하는 방법을 밝히지 않는 "블랙 박스"모델

본 논문에서는 고성능 다중 지평선 예측과 시간적 동역학에 대한 해석 가능한 통찰력을 결합한

새로운 관심 기반 아키텍처인 시간 융합 변환기(TFT)를 소개

emporal Fusion Transformer (TFT)

- 서로 다른 스케일에서 시간 관계를 학습하기 위해 TFT는 로컬 처리를 위해 반복 레이어를 사용하고 장기 종속성을 위해 해석 가능한 자체주의 레이어를 사용

- TFT는 특수한 구성 요소를 사용하여 관련 기능을 선택하고 일련의 게이팅 레이어가 불필요한 구성 요소를 억제하므로 광범위한 시나리오에서 고성능을 구현다양한 실제 데이터셋에서 기존 벤치마크 대비 상당한 성능 향상을 보여주며, TFT의 세 가지 실용적 해석 가능성 활용 사례를 보여줌

👀 key words

Deep learning, Interpretability, Time series, Multi-horizonforecasting, Attention mechanisms, Explainable AI.

1️⃣ INTRODUCTION

Multi-horizon forecasting

- 여러 미래 시간 단계에서 관심 변수를 예측하는 것은 시계열 기계 학습에서 중요한 문제

- 한 단계 앞선 예측과 달리 사용자가 전체 경로에서 추정에 액세스할 수 있게하여 향후 여러 단계에서 자신의 행동을 최적화 가능케 함

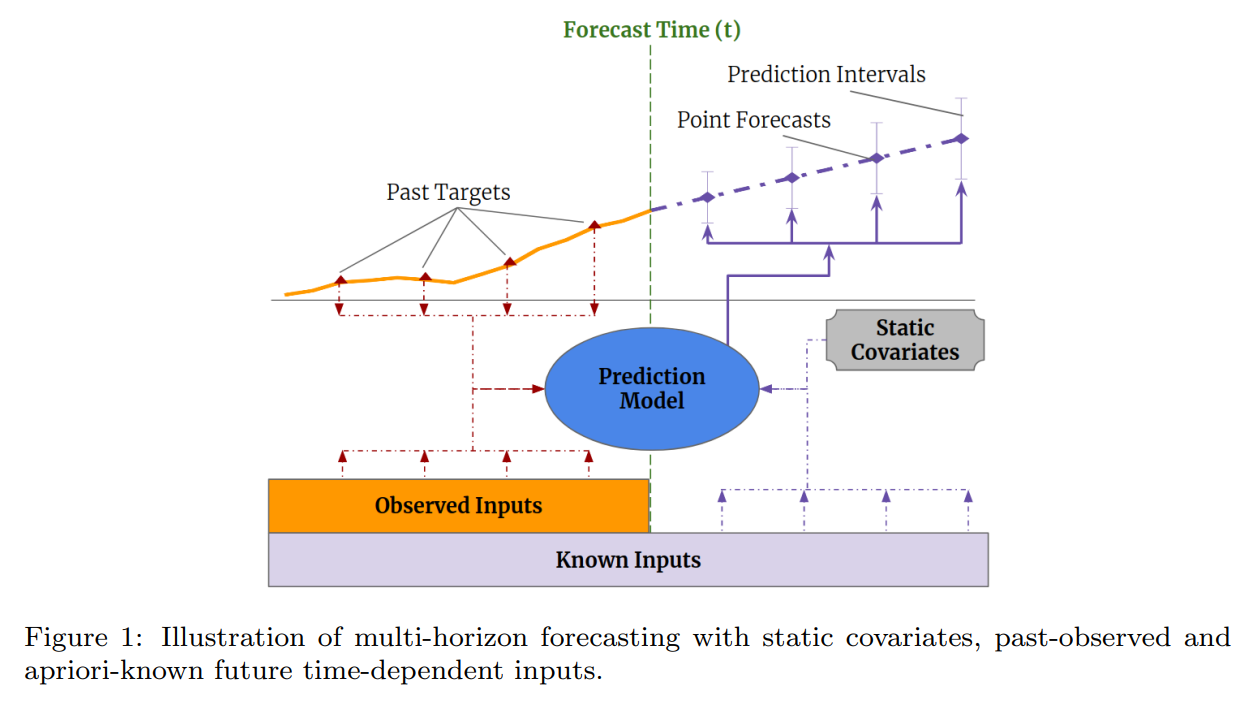

- 실제 다중 수평선 예측 응용 프로그램은 일반적으로 그림 3과 같이 다양한 데이터 소스에 액세스

- 미래에 대한 알려진 정보(예: 다가오는 휴일 날짜), 기타 외생적 시계열(예: 고객 이동 기록) 및 정적 메타데이터(예: 상점 위치)를 포함하여 상호 작용하는 방식에 대한 사전 지식 없이 이루어짐

- 데이터 소스의 이러한 이질성과 상호 작용에 대한 정보가 거의 없기 때문에 다중 수평 시계열 예측은 특히 어려움

- 심층 신경망(DNN)은 다중 수평선 예측에 점점 더 많이 사용되어 전통적인 시계열 모델에 비해 강력한 성능 향상을 보여줌 [6, 7, 8]

- 많은 아키텍처가 반복 신경망(RNN) 아키텍처의 변형[9, 6, 10]에 초점을 맞추고 있지만, 최근의 개선은 또한 Transformer기반 모델[12]을 포함하여 과거 [11]에서 관련 시간 단계의 선택을 향상시키기 위해 attention-based 방법을 사용

- 시계열 모델의 최근 많은 개선은 고유한 데이터 특성을 가진 아키텍처의 정렬에서 비롯됨 [13, 14]

- multi-horizon forecasting 을 위한 적절한 inductive 편향을 가진 네트워크를 설계함으로써 유사한 성능 이득을 얻을 수 있다고 주장

- 일반적인 다중 수평선 예측 입력의 이질성을 고려하지 않는 것 외에도, 대부분의 최신 아키텍처는 예측이 많은 매개변수 간의 복잡한 비선형 상호 작용에 의해 제어되는 '블랙박스' 모델

- 모델이 예측에 도달하는 방법을 설명하기 어렵게 만들고, 결과적으로 사용자가 모델의 출력을 신뢰하고 모델 빌더가 이를 디버그하는 것을 어렵게 만듦

- DNN에 대해 일반적으로 사용되는 설명 가능성 방법은 시계열에 적용하기에 적합하지 않음

- 기존 형식에서 사후 방법(예: LIME [15] 및 SHAP [16])은 입력 기능의 시간 순서를 고려하지 않음

- ex) LIME의 경우 surrogate 모델이 각 데이터 포인트에 대해 독립적으로 구성되고 SHAP의 경우 인접 시간 단계에 대해 기능이 독립적으로 고려

- 사후 접근 방식은 시간 단계 간의 종속성이 일반적으로 시계열에서 중요하므로 설명 품질이 좋지 않음

- 반면에 Transformer 아키텍처[17]와 같이 주로 언어 또는 음성과 같은 순차적 데이터에 대한 고유한 해석 가능성을 가진 일부 attention 기반 아키텍처가 제안됨

- 이를 적용하기 위한 기본적인 주의 사항은 다중 수평선 예측에는 언어나 음성과 달리 다양한 유형의 입력 기능이 포함된다는 것

- 기존 형식에서 이러한 아키텍처는 다중 수평 예측을 위한 관련 시간 단계에 대한 통찰력을 제공할 수 있지만 주어진 시간 단계에서 다양한 기능의 중요성을 구별할 수는 없음

- 고성능을 위한 다중 수평 예측에서 데이터의 이질성을 해결하는 새로운 방법의 경우 사용 사례의 요구 사항을 감안할 때 이러한 예측을 해석 가능하게 만드는 새로운 방법도 필요

- 우리는 새로운 형태의 해석 가능성을 가능하게 하는 동시에 고성능을 달성하는 multi-horizon 예측을 위한 attention기반 DNN 아키텍처인 TFT(Temporal Fusion Transformer)를 제안

- 아키텍처를 다중 수평 예측에 공통적인 잠재적 입력 및 시간 관계의 전체 범위와 정렬하는 여러 참신한 아이디어를 도입

- (1) 정적 공변량 인코더를 통합. 네트워크의 다른 부분에서 사용하기 위해 컨텍스트 벡터를 인코딩

- (2) 전체에 걸친 게이팅 메커니즘 및 관련 없는 입력의 기여를 최소화하기 위한 샘플 종속 변수 선택

- (3) 알려진 입력 및 관찰된 입력을 로컬로 처리하기 위한 시퀀스 대 시퀀스 레이어

- (4) 데이터 세트 내에 존재하는 long-term 종속성을 학습하기 위한 temporal self-attention 디코더

- 특수 구성 요소를 사용하면 해석 가능성도 높아짐

- TFT가 세 가지 가치 있는 해석 가능성 사용 사례를 가능하게 한다는 것을 보임

- 사용자가 (i) 예측 문제에 대한 전 세계적으로 중요한 변수

- (ii) 지속적인 시간 패턴 및

- (iii) 중요한 이벤트를 식별하도록 도움

- TFT가 제공하는 insights 과 benefits 뿐만 아니라 TFT가 실제로 어떻게 적용될 수 있는지 보여줌

- 아키텍처를 다중 수평 예측에 공통적인 잠재적 입력 및 시간 관계의 전체 범위와 정렬하는 여러 참신한 아이디어를 도입

2️⃣ Related Work

🖤 Multi-horizon Forecasting 을 위한 DNN :

- 최근의 딥러닝 방법은 autoregressive 모델[9, 6, 12]을 사용하는 반복 접근 방식과 sequence-to-sequence 모델을 기반으로 하는 direct 방식[10, 11]으로 분류

- Iterated 접근 방식은 한 단계 앞서가는 예측 모델을 활용하며, 예측을 미래 입력에 재귀적으로 공급하여 얻은 다단계 예측을 사용

- LSTM(Long Short-Term Memory)

- 적층된 LSTM 레이어를 사용하여 one-step-ahead Gaussian predictive distributions 의 매개변수를 생성하는 Deep AR[9]과 같이 고려

- DSSM(Deep State-Space Models)[6]

- LSTM을 활용하여 Kalman 필터링을 통해 생성된 예측 분포와 함께 미리 정의된 선형 상태 공간 모델의 매개변수를 생성하는 유사한 접근 방식을 채택하고 [21]의 다변량 시계열 데이터에 대한 확장을 사용

- Transformer 기반 아키텍처가 [12]에서 탐색

- 예측하는 동안 receptive field 의 크기를 증가시키기 위해 local 처리 및 sparse attention 메커니즘을 위한 컨볼루션 계층의 사용을 제안

- LSTM(Long Short-Term Memory)

- 단순함에도 불구하고 iterative 방법은 target 를 제외한 모든 변수의 값이 예측 시점에 알려져 있다는 가정에 의존

- target 만 미래 입력에 recursively 으로 공급되어야 함

- 많은 실제 시나리오에서 사전에 알려지지 않은 많은 유용한 time-varying 입력이 존재

- iterative 접근 방식에서는 straightforward 사용이 제한

- but TFT는 입력의 다양성을 명시적으로 설

- 자연스럽게 static covariates 과 (과거 관찰된 것과 미래에 알려진) time-varying 입력을 처리

- 대조적으로, direct 방법은 각 시간 단계에서 미리 정의된 여러 기간에 대한 예측을 명시적으로 생성하도록 훈련

- 그들의 아키텍처는 일반적으로 sequence-to-sequence 모델에 의존

- LSTM은 과거의 입력을 요약하고 미래 예측을 생성하는 다양한 방법을 인코딩

- Multi-horizon Quantile Recurrent Forecaster(MQRNN)[10]는 LSTM 또는 컨볼루션 인코더를 사용하여 각 horizon에 대해 multi-layer perceptrons (MLP)에 공급되는 context vectors를 생성

- [11]에서 multi-modal attention 주의 메커니즘은 bi-directional LSTM 디코더에 대한 context vectors 를 구성하기 위해 LSTM 인코더와 함께 사용

- LSTM 기반 iterative 방법보다 성능이 우수함에도 불구하고 이러한 standard direct 방법의 해석 가능성(interpretability )은 여전히 어려움

- 대조적으로, 우리는 attention 패턴을 해석함으로써 TFT가 시간 역학에 대한 통찰력 있는 설명을 제공할 수 있고 다양한 데이터 세트에서 최첨단 성능을 유지

🖤 Time Series Interpretability with Attention :

- Attention 메커니즘은 translation [17], 이미지 분류[22] 또는 tabular 학습[23]에 사용되어 attention weights 의 크기를 사용하여 각 인스턴스에 대한 입력의 두드러진(salient) 부분을 식별

- LSTM 기반[25] 및 transformer기반[12] 아키텍처를 사용하여 해석 가능성(interpretability)이 있는 시계열에 맞게 조정

- but, static covariates 의 중요성을 고려하지 않고 수행(위의 방법은 각 입력에서 변수를 혼합하기 때문)

- TFT는 기여 시간에 따라 달라지는 입력을 결정하기 위해 self-attention 외에 각 시간 단계에서 static 기능에 대해 별도의 encoder-decoder attention를 사용하여 이를 완화

🖤 Instance-wise Variable Importance with DNNs:

- Instance (즉, 샘플)별 variable 중요도는 사후 설명 방법[15, 16, 26]과 본질적으로 해석 가능한 모델[27, 24]을 사용하여 얻음

- 사후(post-hoc) 설명 방법

- ex) LIME [15], SHAP [16] 및 RL-LIM [26]은 사전 훈련된 블랙박스 모델에 적용되며 종종 대리(surrogate) 해석 가능한 모델로 추출하거나 feature 속성으로 분해하는 것을 기반으로 함

- 입력의 시간 순서를 고려하도록 설계되지 않았으므로 복잡한 시계열 데이터에 대한 사용이 제한

- 본질적으로 해석 가능한 모델링 접근 방식은 기능 선택을 위한 구성 요소를 아키텍처에 직접 구축

- 시계열 예측의 경우 time-dependent 변수 기여도를 명시적으로 수량화(quantifying)하는 것을 기반

- ex) 해석 가능한 Multi-Variable LSTM[27]은 각 변수가 고유한 memory segment 에 기여하도록 숨겨진 상태를 분할하고 변수 기여를 결정하기 위해 메모리 세그먼트에 가중치를 부여

- 시간적 중요도와 변수 선택을 결합하는 방법도 [24]에서 고려되었으며, 각각의 attention 가중치를 기반으로 단일 기여 계수를 계산

- but, 한 단계 앞선 예측만 모델링하는 단점 외에도 기존 방법은 global temporal dynamics 에 대한 insights 을 제공하지 않고 attention 가중치의 instance (즉, 샘플별) 해석에 중점을 둠

- 대조적으로, Sec. 7은 TFT가 전역(global) 시간 관계를 분석할 수 있고 사용자가 전체 데이터 세트에 대한 모델의 전역 행동을 해석할 수 있도록 하며 특히 지속적인 패턴(예: 계절성 또는 지연 효과) 및 존재하는 체제(regimes)를 식별할 수 있음

3️⃣ Multi-horizon Forecasting

- 주어진 시계열 데이터 세트에 I 고유 엔터티가 있다고 가정

- 각 개체 i는 각 시간 단계 t ∈ [0, Ti ]에서 입력 χ i,t ∈ R mχ 및 스칼라 목표 yi,t ∈ R 뿐만 아니라 정적 공변량 si ∈ R ms 세트와 연결

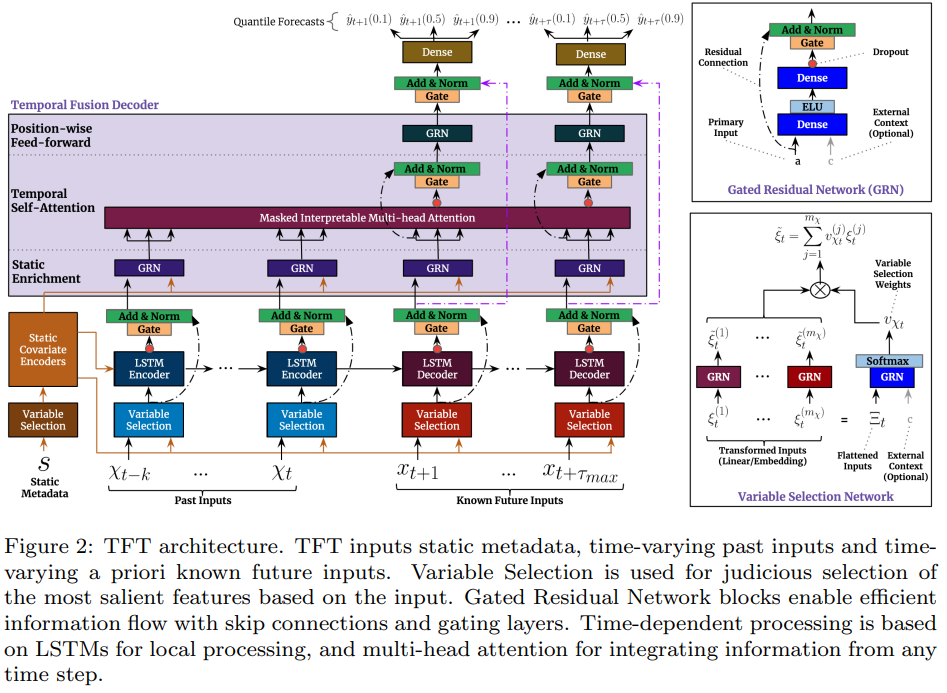

- 다중 수평 예측 설정에 분위수 회귀를 채택

- 시간 t에서 τ-step-ahead 예측의 예측된 q번째 샘플 분위수이고 fq(.)는 예측 모델

4️⃣ Model Architecture

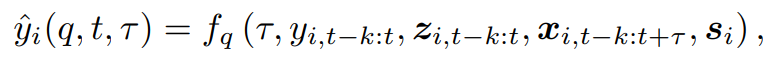

- 다양한 문제에 대한 높은 예측 성능을 위해 각 입력 유형(즉, static, known, observed inputs)에 대한 기능 표현을 효율적으로 구축하기 위해 표준 구성 요소를 사용하도록 TFT를 설계

- TFT의 주요 구성 요소

- 1. 아키텍처의 사용되지 않는 구성 요소를 건너뛰는 gating 메커니즘으로 광범위한 데이터 세트 및 시나리오를 수용할 수 있도록 adaptive 깊이와 네트워크 complexity 을 제공

- 2. 변수 선택 네트워크는 각 시간 단계에서 관련 입력 변수를 선택

- 3. Static covariate 인코더는 시간적 역학을 조절하기 위한 context vectors 의 인코딩을 통해 정적 기능을 네트워크에 통합

- 4. 관찰된 입력과 알려진 time-varying 입력 모두에서 long- and short-term 시간 관계를 학습하기 위한 시간 처리.

시퀀스 간 계층은 로컬 처리에 사용되는 반면 long-term 종속성은 새로운 해석 가능한 multi-head attention block을 사용하여 캡처 - 5. 각 예측 범위에서 가능한 목표 값의 범위를 결정하기 위한 분위수 예측을 통한 예측 간격

그림 2는 TFT(Temporal Fusion Transformer)의 상위 수준 아키텍처를 보여주며 개별 구성 요소는 후속 섹션에서 자세히 설명

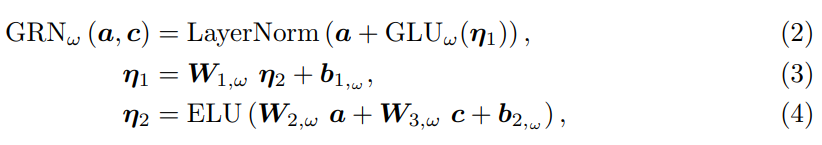

➕ 4.1. Gating Mechanisms

- exogenous 입력과 targets 간의 정확한 관계는 사전에 알려지지 않아 어떤 변수가 관련이 있는지 예측하기 어려움

- 필요한 비선형 처리의 범위를 결정하기 어렵고 더 간단한 모델이 도움이 될 수 있는 경우가 있음

- 데이터 세트가 작거나 노이즈가 많은 경우

- 모델에 필요한 경우에만 비선형 처리를 적용할 수 있는 유연성을 제공하기 위해 TFT의 빌딩 블록으로 그림 2와 같은 GRN(Gated Residual Network)을 제안

- GRN은 기본 입력과 optional context vector c를 받아 다음을 생성

➕ 4.2. Variable Selection Networks

- 여러 변수를 사용할 수 있지만 출력에 대한 relevance 과 특정 contribution 는 일반적으로 알 수 없음

- TFT는 static covariates 과 time-dependent covariates 모두에 적용되는 변수 선택 네트워크를 사용하여 instance 별 변수 선택을 제공하도록 설계

- 예측 문제에 가장 중요한 변수에 대한 insights 을 제공하는 것 외에도 변수 선택을 통해 TFT는 성능에 부정적인 영향을 줄 수 있는 불필요한 잡음 입력을 제거

- 대부분의 실제 시계열 데이터 세트에는 예측 content 가 적은 기능이 포함되어 있으므로 변수 선택은 가장 두드러진 항목에서만 학습 용량을 활용하여 모델 성능을 크게 도울 수 있음

- categorical 변수에 대한 entity 임베딩[31]을 특징 표현으로 사용하고 연속 변수에 대한 선형 변환을 사용

- 각 입력 변수를 건너뛰기 연결을 위해 후속 레이어의 차원과 일치하는 (dmodel) 차원 벡터로 변환

- 모든 정적, 과거 및 미래 입력은 별도의 변수 선택 네트워크를 사용 (그림 2에서 다른 색상으로 표시됨)

- generality 을 잃지 않고 과거 입력에 대한 변수 선택 네트워크를 제시

- 다른 입력에 대한 선택은 동일한 형식을 취한다는 점에 유의

➕ 4.3. Static Covariate Encoders

- 다른 시계열 예측 아키텍처와 달리 TFT는 별도의 GRN 인코더를 사용하여 4가지 다른 컨텍스트 벡터인 cs, ce, cc 및 ch를 생성하여 static metadata, 의 정보를 통합하도록 신중하게 설계

- contect vectors 는 static 변수가 처리에서 중요한 역할을 하는 temporal fusion 디코더(4.5절)의 다양한 위치에 연결

- (1) 시간 변수 선택(cs), (2) 시간 기능의 로컬 처리(cc, ch), (3) 정적 정보로 시간 기능 강화(ce)에 대한 컨텍스트가 포함

- EX) ζ를 정적 변수 선택 네트워크의 출력으로 사용하면 시간 변수 선택을 위한 컨텍스트는 cs = GRNcs(ζ)에 따라 인코딩

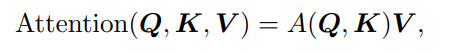

➕ 4.4. Interpretable Multi-Head Attention

- TFT는 설명 가능성을 높이기 위해 transformer 기반 아키텍처[17, 12]의 multi-head attention 에서 수정하여 서로 다른 시간 단계에서 장기적인 관계를 학습하기 위해 self-attention 메커니즘을 사용

- 일반적으로 self-attention 메커니즘은 키 K ∈ R N×dattn과 쿼리 Q ∈ R N×dattn 간의 관계를 기반으로 값 V ∈ R N×dV를 아래와 같이 조정

➕ 4.5. Temporal Fusion Decoder

- temporal fusion decoder 는 데이터 세트에 존재하는 시간 관계를 학습하기 위해 아래에 설명된 일련의 계층을 사용

➕ 4.5.1. Locality Enhancement with Sequence-to-Sequence Layer

- 시계열 데이터에서 중요 지점은 종종 주변 값과 관련하여 식별(예: 이상, 변화 지점 또는 순환 패턴)

- 포인트 단위 값 위에 패턴 정보를 활용하는 기능의 구성을 통해 local context 를 활용하면 attention 기반 아키텍처의 성능이 향상

- EX) [12]는 항상 동일한 필터를 사용하여 로컬 패턴을 추출하는 지역 향상을 위해 single convolutional layer을 채택

- BUT 과거 및 미래 입력의 수가 다르기 때문에 관찰된 입력이 존재하는 경우에는 적합하지 않을 수 있음

- 일반적으로 사용되는 시퀀스 간 기준선과의 비교를 위해 LSTM encoder-decoder 사용을 고려

- 표준 위치 인코딩을 대체하는 역할을 하여 입력의 시간 순서에 적절한 inductive 바이어스를 제공

- static metadata 가 로컬 처리에 영향을 줄 수 있도록 static covariate 인코더의 cc, ch 컨텍스트 벡터를 사용하여 계층의 첫 번째 LSTM에 대해 각각 셀 상태와 은닉 상태를 초기화

- 이 레이어에 게이트 skip connection 을 사용

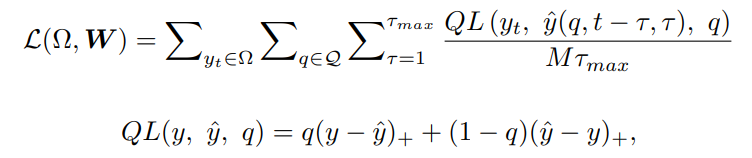

5️⃣ 5. Loss Functions

- TFT는 모든 quantile 출력에서 합산된 quantile loss[10]를 공동으로 최소화하여 훈련

6️⃣ 6. Performance Evaluation

➕ 6.1. Datasets

- 광범위한 다중 수평선 예측 문제에서 일반적으로 관찰되는 특성을 반영하기 위해 데이터 세트를 선택

- 이전 학술 작업과 관련하여 기준선과 위치를 설정하기 위해 먼저 [9, 6, 12]에서 사용된 전기 및 교통 데이터 세트의 성능을 평가

- 대상 옆에만 알려진 입력을 포함하는 더 간단한 일변량 시계열에 중점을 둠

- Retail 데이터 세트는 풍부한 static metadata 및 관찰된 time-varying 입력을 포함하여 multi-horizon prediction 애플리케이션(섹션 3 참조)에서 관찰된 복잡한 입력의 전체 범위를 사용하여 모델을 벤치마킹하는 데 도움이 됨

- 더 작은 노이즈 데이터 세트에 대한 과적합에 대한 견고성을 평가하기 위해 다른 것보다 훨씬 작은 데이터 세트를 사용하여 변동성 예측의 재정적 적용을 고려

- 각 데이터 세트에 대한 설명

- Electricity : [32]에서와 같이 시간 단위로 집계된 370명의 고객의 전기 소비를 포함하는 UCI 전기 부하 다이어그램 데이터 세트. [9]에 따라 지난 주(즉, 168시간)를 사용하여 다음 24시간 동안 예측

- Traffic : UCI PEM-SF 교통 데이터 세트는 [32]에서와 같이 440 SF 베이 지역 고속도로의 점유율(yt ∈ [0, 1] 포함)을 설명. 동일한 look back window 및 예측 기간을 사용하여 전력 데이터 세트에 따라 시간별 수준으로 집계

- Retail : Kaggle 대회[33]의 Favorita Grocery Sales Dataset. 다양한 제품 및 상점에 대한 메타데이터와 일일 수준에서 샘플링된 다른 외생적 시간 변화 입력을 결합. 90일 간의 과거 정보를 사용하여 향후 30일 동안의 로그 제품 판매를 예측

- Volatility (또는 Vol.) : OMI 실현 라이브러리[34]에는 일일 수익률과 함께 일중 데이터에서 계산된 31개 주가 지수의 일일 실현 변동성 값이 포함. 실험을 위해 지난 1년(즉, 252영업일) 동안의 정보를 사용하여 다음 주(영업일 기준 5일) 동안의 예측을 고려

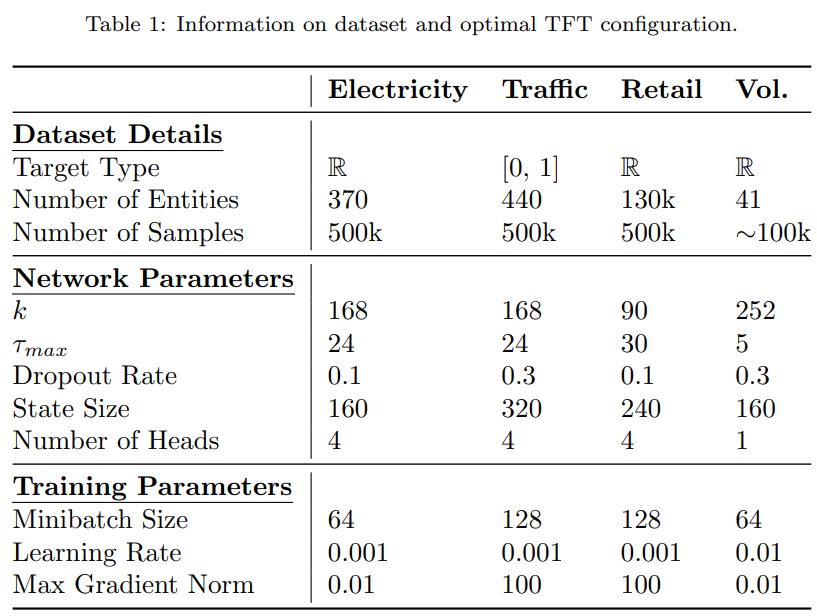

➕ 6.2. Training Procedure

- 각 데이터 세트에 대해 모든 시계열을 학습을 위한 훈련 세트, 하이퍼파라미터 튜닝을 위한 검증 세트, 성능 평가를 위한 홀드아웃 테스트 세트의 3개 부분으로 나눔

- Hyperparameter 최적화는 Volatility에 대해 240회, others 에 대해 60회 iterations을 사용하여 무작위 검색을 통해 수행

- 모든 Hyperparameter 에 대한 전체 검색 범위는 표 1에 나열된 데이터 세트 및 최적 모델 매개변수

- State size – 10, 20, 40, 80, 160, 240, 320

- Dropout rate – 0.1, 0.2, 0.3, 0.4, 0.5, 0.7, 0.9

- Minibatch size – 64, 128, 256

- Learning rate – 0.0001, 0.001, 0.01

- Max. gradient norm – 0.01, 1.0, 100.0 • Num. heads – 1, 4

➕ 6.3. Computational Cost

- 모든 데이터 세트에서 각 TFT 모델은 단일 GPU에서도 훈련되었으며 광범위한 컴퓨팅 리소스 없이 배포

- ex) NVIDIA Tesla V100 GPU를 사용하는 경우 최적의 TFT 모델(전기 데이터 세트용)은 학습하는 데 6시간이 약간 넘게 걸림 (각 에포크는 대략 52분)

- 전체 검증 데이터 세트(50,000개 샘플로 구성)에 대한 일괄 추론에는 8분

- 하드웨어별 최적화를 통해 TFT 훈련 및 추론 시간을 더욱 줄일 수 있음

➕ 6.4. Benchmarks

- 섹션에 설명된 범주를 기반으로 TFT를 다중 수평 예측을 위한 다양한 모델과 광범위하게 비교

- 하이퍼파라미터 최적화는 동일한 수의 사전 정의된 검색 공간에서 무작위 검색을 사용하여 수행

- 주어진 데이터 세트에 대한 모든 벤치마크에 대한 반복

- Direct methods : TFT가 multi-horizon 모델의 이 클래스에 속하기 때문에 우리는 주로 다음을 포함하여 future horizons 에서 예측을 직접 생성하는 딥 러닝 모델에 대한 비교에 중점을 둠

- 1) global contexts (Seq2Seq)가 있는 단순 sequence-to-sequence models

- 2) Multi-horizon Quantile Recurrent Forecaster(MQRNN) [10]

- Iterative methods : 작업의 풍부한 본체와 관련하여 위치 지정. 반복 모델에서 우리는 전기 및 교통 데이터 세트에 대해 [9]와 동일한 설정을 사용하여 TFT를 평가

- 1) DeepAR [9]

- 2) DSSM [6]

- 3) ConvTrans라고 하는 로컬 컨볼루션 처리를 사용하는 [12]의 Transformer 기반 아키텍처에 대한 [12]의 결과를 확장

- 더 복잡한 데이터 세트의 경우 이전 작업에서 다른 반복 모델보다 뛰어난 성능을 제공하는 ConvTrans 모델과 실무자들 사이에서 인기가 있기 때문에 DeepAR에 중점을 둠

- 예측을 생성하기 위해 미래의 모든 입력에 대한 지식이 필요하므로 알 수 없는 입력을 마지막 사용 가능한 값으로 대치하여 복잡한 데이터 세트에 대해 이를 수용

➕ 6.5. Results and Discussion

- 표 2는 TFT가 Sec에 설명된 다양한 데이터 세트에 대해 모든 벤치마크를 훨씬 능가한다는 것을 보여줌

- 6.1. 중앙값 예측의 경우 TFT는 차선책 모델에 비해 평균적으로 7% 더 낮은 P50 및 9% 더 낮은 P90 손실을 산출하여 아키텍처를 일반적인 다중 수평 예측 문제와 명시적으로 정렬하는 이점을 보여줌

- 직접 및 반복 모델을 비교하여 관찰된 입력에 대한 설명의 중요성을 관찰

관찰된 입력 전가가 필요한 복잡한 데이터 세트(즉, 변동성 및 소매) - quantile 회귀의 이점은 목표가 해당 시나리오에서 성능이 우수한 직접 모델을 사용하는 가우스 분포에 의해 잘 포착되지 않는 경우에도 관찰

- ex) target 분포가 크게 왜곡된 Traffic 데이터 세트에서 볼 수 있음

- 점유율의 90% 이상이 0과 0.1 사이에 있고 나머지는 1.0까지 균등하게 분포

어

렵

다

'👩💻 인공지능 (ML & DL) > Serial Data' 카테고리의 다른 글

| [논문리뷰] Machine Learning for Anomaly Detection on VM and Host Performance Metrics (1) | 2022.09.26 |

|---|---|

| fbprophet 시계열 데이터로 웹 트래픽 감지 (1) | 2022.09.23 |

| LSTM(+GRU)을 이용한 삼성전자(+NAVER) 주가 예측하기 (2) | 2022.09.22 |

| [Kaggle] Time-series data analysis using LSTM (1) | 2022.09.20 |

| [논문리뷰] Time Series Forecasting (TSF) Using Various Deep Learning Models (1) | 2022.09.19 |